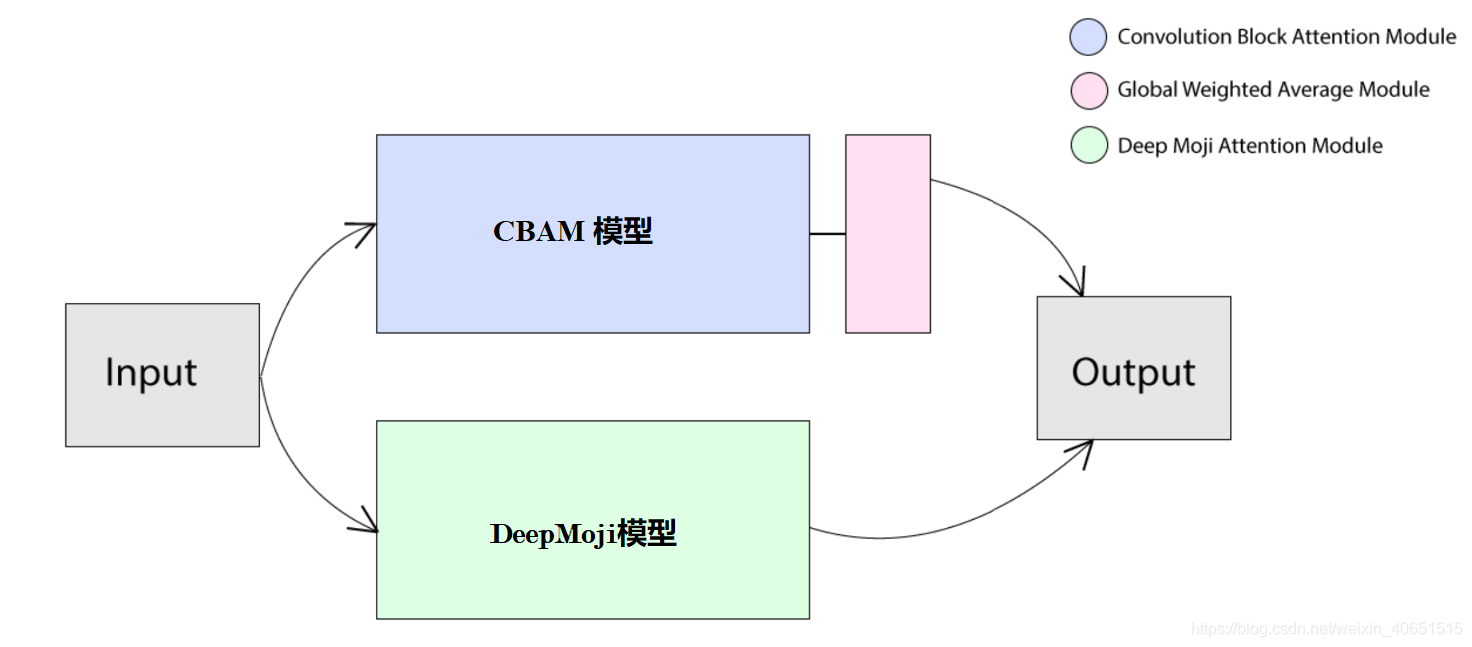

实现深度学习中,对图像的注意力机制,强化网络的学习能力,提高网络精度和泛化能力。

”cbam-keras cbam-keras-master keras keras_cbam 注意力“ 的搜索结果

CBAM-Keras 这是实现。 该存储库还包括,因此您可以在基本的CNN模型,带有CBAM块的基本模型和带有SE块的基本模型之间进行训练和比较。CBAM:卷积块注意模块CBAM提出了一个称为“卷积块注意模块”(CBAM)块的体系...

注意力机制使用;卷积神经网络的变体keras实现

CBAM_keras_model_keras_densenet_残差网络_inceptionnet_注意力机制.zip

CBAM_keras_model_keras_densenet_残差网络_inceptionnet_注意力机制_源码.zip

CBAM就是结合了通道注意力和空间注意力的一种注意力结构,与SE模块相比,多了空间注意力! 2.CBAM的结构图 如图,整体结构就是先对特征图进行通道注意力加权,然后再进行空间注意力加权操作,很简单。 2.1 CBAM的...

CBAM注意力机制模块介绍2.模块复现2.1 TensorFlow 2.0 卷积神经网络实战书上的代码(tf与keras混合的代码)2.2 Keras代码复现2.3 测试3. 知识点补充3.1 全局平均/最大池化3.2 Keras构建模型 1. CBAM注意力机制模块...

3D注意事项 Sanghyun Woo, et al. "CBAM: Convolutional Block Attention Module." arXiv preprint arXiv:1807.06521v2 (2018). 代码: class channel_attention ( tf . keras . layers . Layer ): """ channel...

主要介绍了使用keras实现densenet和Xception的模型融合,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

CBAM-CNN-LSTM模型是一种结合了卷积神经网络(CNN)、循环神经网络(LSTM)和通道与空间注意力机制(CBAM)的混合模型,用于股票预测。下面是一个简单的伪代码示例,展示了CBAM-CNN-LSTM模型的主要步骤: ```python...

keras-deeplab-v3-plus-master_deeplab_v3plus_遥感_分割_遥感语义分割_遥感分割_源码.zip

keras实现CBAM注意力机制模块

前言: CBAM模块由于其使用的广泛性以及易于集成得到很多应用。...注意力机制(Attention Mechanism)是机器学习中的一种数据处理方法,广泛应用在自然语言处理、图像识别及语音识别等各种不同类型的机器学习任务中...

CBAM: Convolutional Block Attention Module及其keras实现

Non-local 与 SENet、CBAM 模块融合:GCNet、DANet

以下是一维CBAM注意力机制的Keras代码示例: ```python from keras.layers import Input, Dense, Conv1D, Activation, Multiply, Add, Lambda from keras.models import Model from keras import backend as K def...

混合域注意力机制CBAM

keras版本 keras版本对比 paddlepaddle版本 def channel_attention(self, input_feature, index, ratio=0.125): channel = int(input_feature.shape[1]) size = int(channel * ratio) size = 1 if size < 1 ...

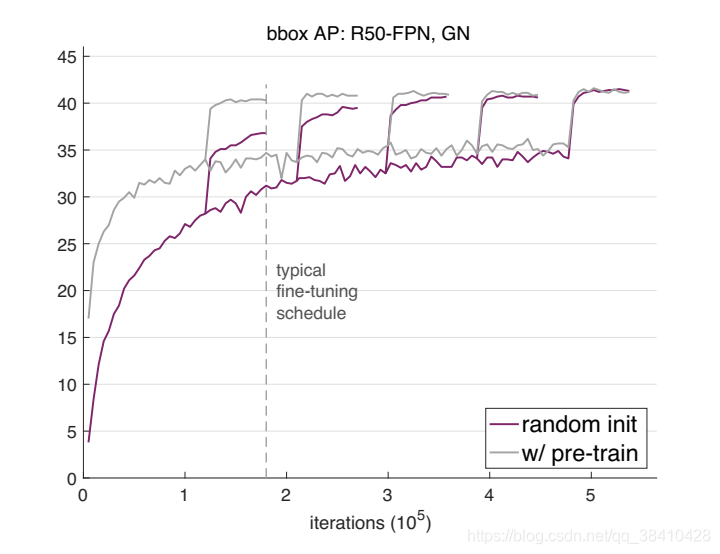

keras, TensorFlow中加入注意力机制原文:https://blog.csdn.net/qq_38410428/article/details/103695032第一步:找到要修改文件的源代码在里面添加通道注意力机制和空间注意力机制所需库from keras.layers import ...

推荐文章

- 解决MySQL8.0报错:Unknown system variable 'validate_password_policy'_unknown system variable 'validate_password_policy-程序员宅基地

- 解决jQuery UI API - 图标(Icons)_jquery ui icons.png-程序员宅基地

- Linux安装完成后添加新网卡_linux添加网卡-程序员宅基地

- ASP.NET;存储过程_asp.net更新存储过程-程序员宅基地

- 获取apk证书MD5值的方法_certmd5-程序员宅基地

- Nodejs最佳实践,空闲的时候翻翻_node 获取空闲进程-程序员宅基地

- 微信小程序-JavaScript 3DES对称加密算法加密使用_js 3des-程序员宅基地

- 解决“Windows 安装程序无法配置为在此计算机的硬件上运行”_windows安装程序无法将windows配置为在此计算机上运行-程序员宅基地

- word提示“Word上次启动失败,安全模式可以帮助您解决问题”的解决办法_word上次启动失败,安全模式可以帮助您笔记本电脑-程序员宅基地

- 深入理解线程池(详解)_线程池的工作原理-程序员宅基地